腾讯近期正式发布了 HunyuanImage 3.0 这款模型以其 80B 的参数规模和工业级原生多模态架构 成为目前开源生图领域的佼佼者。它不仅免费开放使用 其生成效果和语义理解能力已能对标业界头部闭源模型 为 AI 爱好者和开发者带来了前所未有的创作工具。

原生多模态架构 解锁思考型创作

HunyuanImage 3.0 的核心亮点在于其“原生多模态”架构。这并非简单地将多个模型串联 而是通过一个统一模型处理文字图片音视频等多种模态的输入与输出。这意味着 HunyuanImage 3.0 拥有了语言模型的“思考能力”和“常识储备”能够像一位自带大脑的画家 利用世界知识推理并精巧地规划图像的布局构图和笔触。这种深度融合打破了传统生图模型仅限于视觉渲染的局限 将图像生成提升到了一个能理解内容并进行创造性思考的新高度。

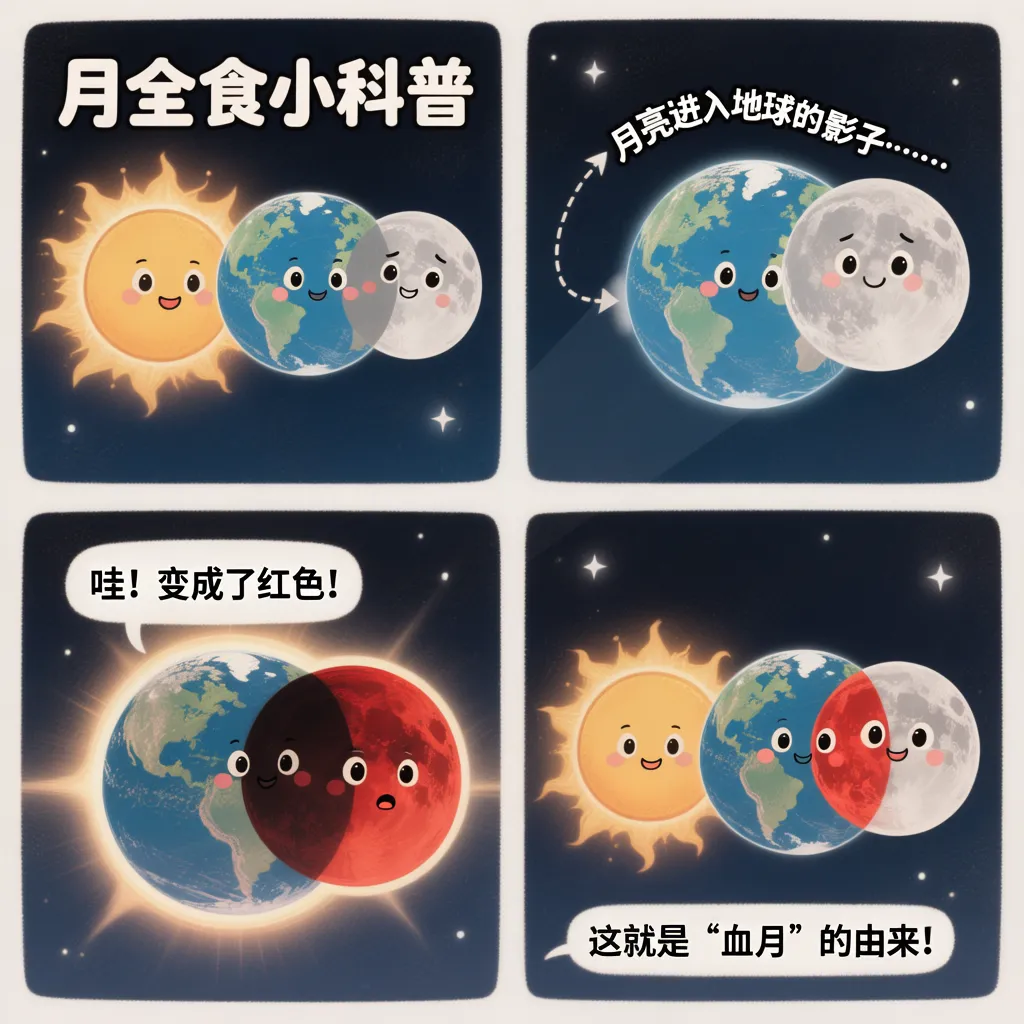

例如 用户只需输入“生成一个月全食的四格科普漫画”HunyuanImage 3.0 便能自主生成完整且逻辑清晰的科普内容 无需用户对每一格画面进行细致描述。这一能力充分展示了其超越简单指令执行的深层思考和推理潜力。

精准语义理解与极致美学质感

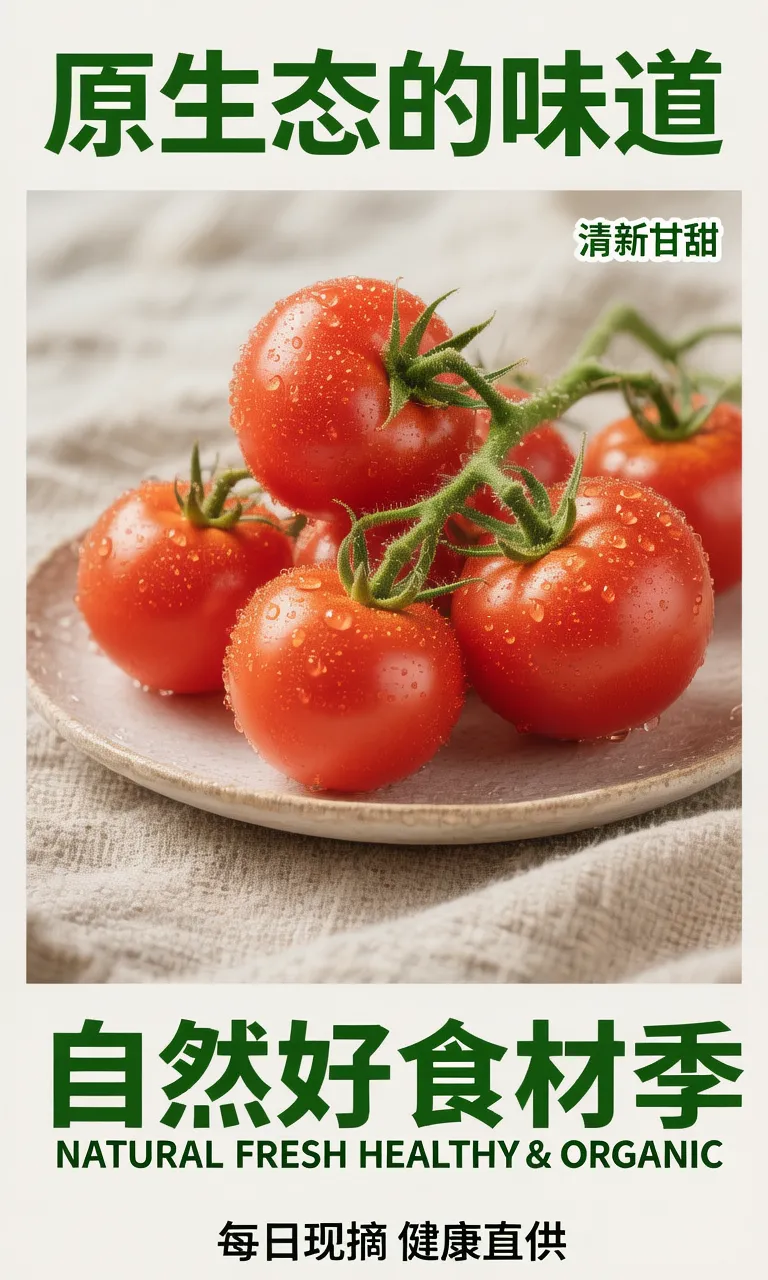

模型在语义理解方面表现卓越 能够准确解析千字级别的复杂提示词 并生成具有极致美学质感的高品质图片。无论是将小红书穿搭博主的需求中模特的全身照分解展示为右侧单独的衣物特写 还是生成带有复杂文字排版和精美视觉元素的商业海报 HunyuanImage 3.0 都能实现高度精确且美观的生成。图片中的小字和长文本都能清晰准确地呈现 画面层次分明 色彩布局和谐 兼具艺术美感与实用价值。

赋能创作者与开发者生态

HunyuanImage 3.0 的发布将大幅提升插画师设计师等视觉创作者的效率。原本耗时数小时的复杂漫画或海报创作 现在可能仅需数分钟即可完成。同时 对于缺乏美术设计经验的内容创作者 也能借助其强大功能轻松产出丰富生动的视觉内容。模型权重及加速版本已在 GitHub 和 Hugging Face 等开源社区发布 为行业研究者企业及个人开发者提供了基于此模型进行应用研发或二次开发的广阔空间。

技术演进与未来展望

HunyuanImage 3.0 基于 Hunyuan-A13B 并在 50 亿量级的图文对视频帧图文交织数据和 6T 的语料数据基础上 进行了多模态生成理解和 LLM 的混合训练。这使其具备了超强的语义理解能力 能够响应复杂的长文本并融合世界知识进行推理。腾讯混元团队透露 目前版本主要开放文生图功能 图生图图像编辑多轮交互等更多强大能力将在后续逐步发布 预示着一个更加全面和智能的图像创作生态即将到来。

体验与资源

用户可以通过以下链接体验和了解 HunyuanImage 3.0

模型体验入口 hunyuan.tencent.com/modelSquare/home/play?from=modelSquare&modelId=289

腾讯混元官网 hunyuan.tencent.com

开源社区 GitHub github.com/Tencent-Hunyuan/HunyuanImage-3.0

开源社区 Hugging Face huggingface.co/tencent/HunyuanImage-3.0

官方还提供了混元图像 3.0 提示词手册 docs.qq.com/doc/DUVVadmhCdG9qRXBU 方便用户深入探索其创作潜力。