最近,英伟达(NVIDIA)抛出了一个颇具颠覆性的观点:未来 Agentic AI(智能体 AI)的核心,将不再是单一的巨型大语言模型(LLM),而是由一系列小型语言模型(SLM)构成的生态系统。这不仅关乎成本效益,更是对 AI 系统设计理念的深层重构,我个人认为,这预示着 AI Agent 将从大一统走向模块化专家团的生物智能分工模式。

告别大模型崇拜

我们普遍认为,AI 越大就越聪明,但英伟达(NVIDIA)的研究却揭示了一个反直觉的真相。目前,多数 AI 智能体的核心都依赖于大型语言模型(LLM)。这些模型虽然能力强大,能够进行决策、规划,并将复杂任务拆解为子任务,但它们也带来了显著的问题。高昂的托管成本、处理延迟、巨大的资源开销,以及商业合作中的各种限制,都让单一 LLM 承担所有智能体任务变得不切实际。英伟达尖锐地指出,现在的情况是本末倒置——AI 智能体的应用设计反而需要去迁就大模型的需求。

英伟达强调,Agentic AI 系统中的许多调用场景,实际上用 SLM 就能很好地胜任。他们明确指出,小型而非大型语言模型才是 Agentic AI 的未来。

NVIDIA 的革新思路

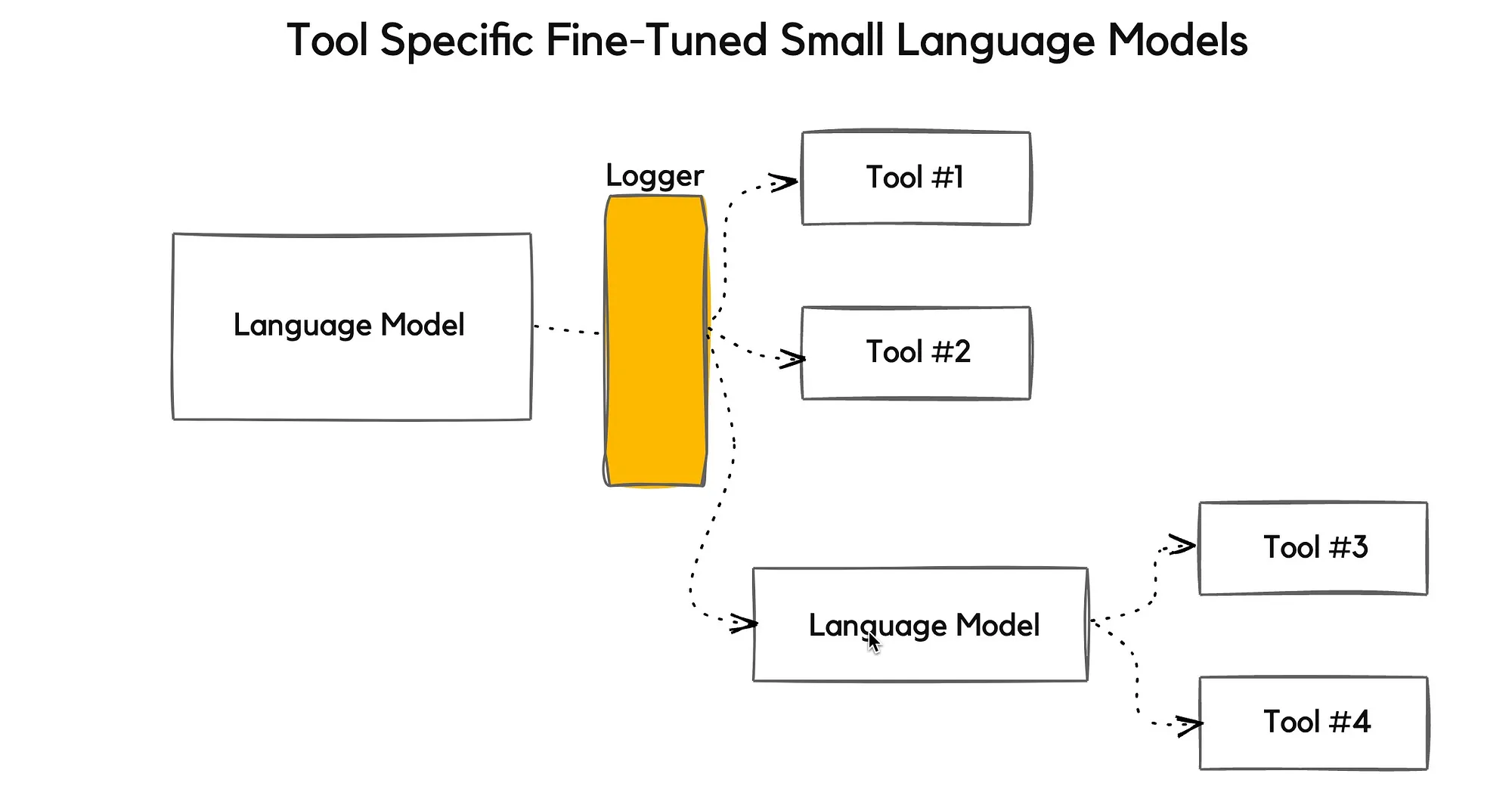

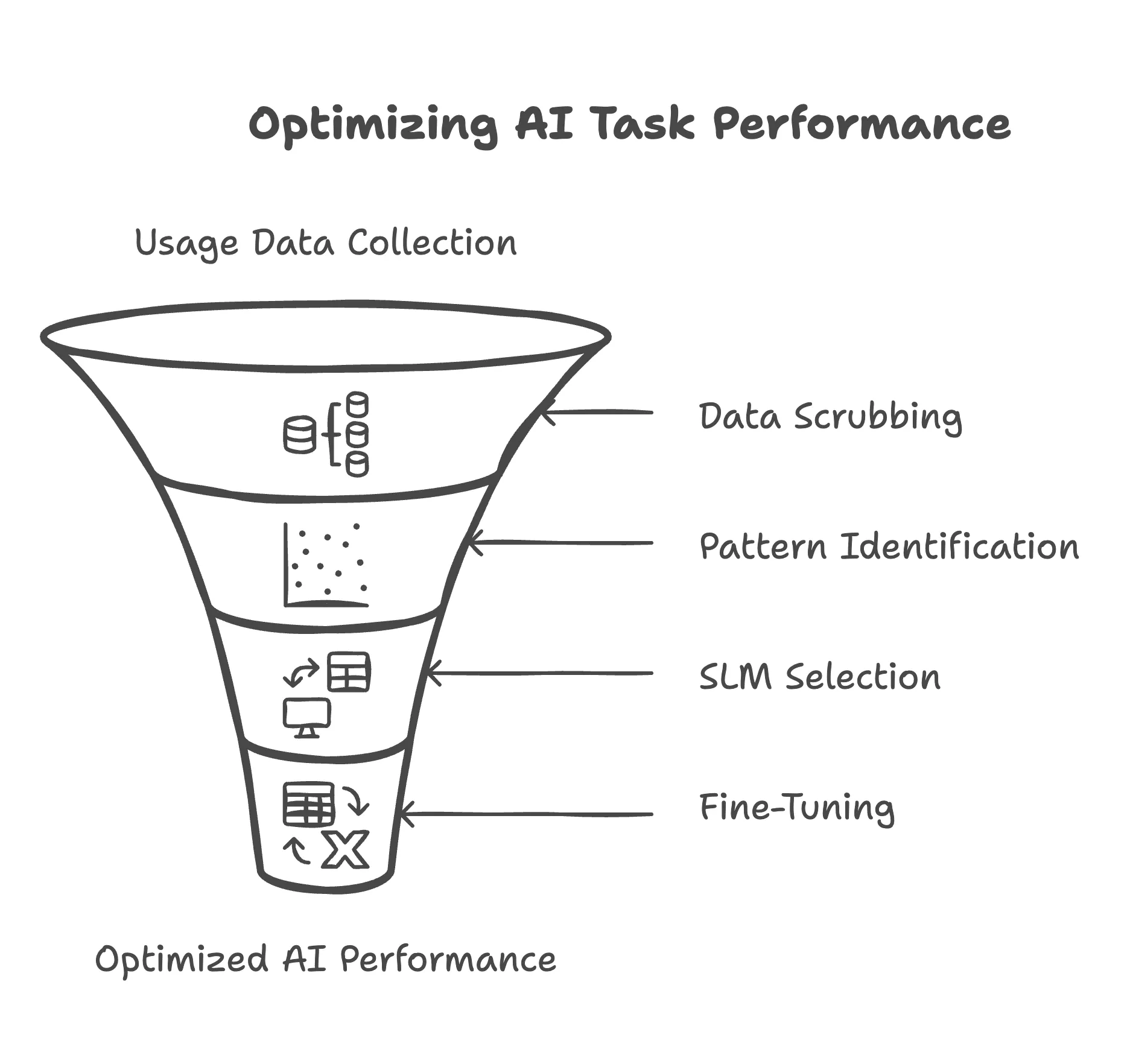

英伟达提出了一个名为数据飞轮的创新框架,旨在通过持续优化来推动 SLM 在 Agentic 系统中的应用。这个流程的核心是:首先分析现有 LLM 的使用数据,识别出重复的任务模式。接着,根据这些模式和可用的工具,对数据进行聚类。最终,针对每个特定的子任务,训练或微调相应的小型语言模型(SLM)。

他们的目标是让 SLM 成为默认选项,而 LLM 只在必要时才被选择性地、少量地调用。英伟达认为,AI 智能体的交互过程,本身就是收集数据以供未来改进的天然途径。这种基于实际用例和使用模式来持续训练和改进 SLM 的方法,让 AI 智能体能够根据具体子任务选择最合适的模型,而非一味依赖大而全的模型。

小型模型的核心优势

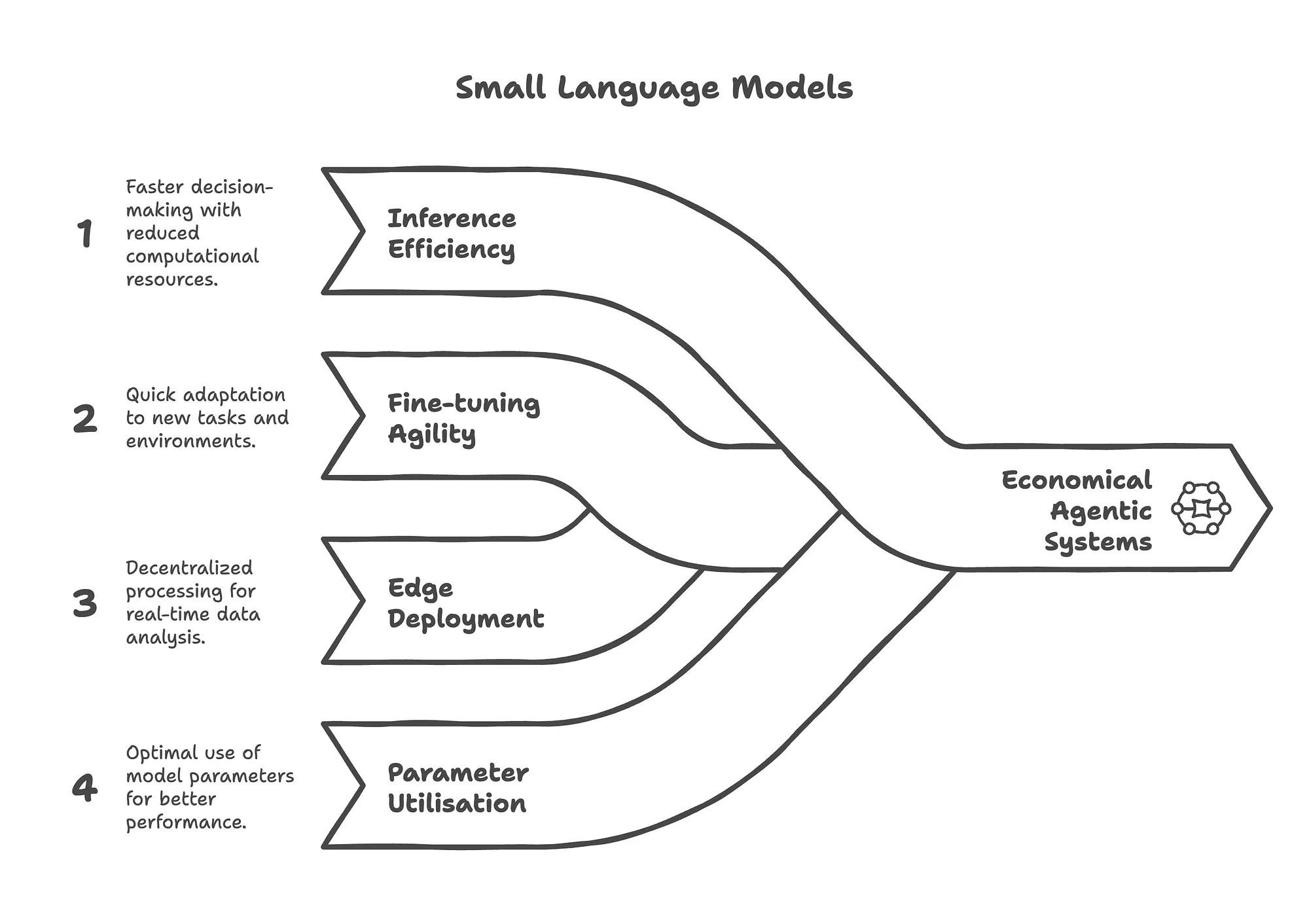

SLM 的优势显而易见:更低的延迟、更少的内存和计算资源需求,以及显著降低的运营成本。在特定领域内,它们完全可以保持足够的任务性能。英伟达强调,现代训练、提示工程和智能体增强技术,使得能力而非参数量成为真正的限制因素。

SLM 之所以在 Agentic 系统中更经济,主要体现在以下几个方面:

- 推理效率高

- 微调灵活

- 更易于部署到边缘设备

- 参数利用率更高

英伟达主张,在 AI 智能体中融入不同规模和能力的语言模型,以处理不同复杂程度的查询或操作,这为 SLM 的引入提供了一条自然途径。

落地挑战与 NVIDIA 策略

尽管 SLM 潜力巨大,但其普及并非没有障碍。高昂的集中式 LLM 基础设施前期投入、SLM 开发中普遍采用的通用基准测试,以及相比 LLM 缺乏市场热度,都是现实的挑战。很多开发者和企业习惯了追逐最新的巨无霸模型,而忽略了小模型的实际价值。

为了帮助开发者和组织克服这些障碍,英伟达提供了一个六步算法,用以将臃肿的通用 LLM 转换为精益、专业的 SLM 智能体:

- 从现有 LLM 设置中收集使用数据。

- 清理敏感信息。

- 通过数据聚类识别重复的任务模式。

- 为每种任务类型选择合适的 SLM。

- 使用定制数据集进行微调。

- 建立持续改进的循环机制,确保 SLM 随着时间推移保持高效和精准。

这个策略提供了一条清晰的路径,帮助企业更有效地利用 SLM 的优势,实现 AI 智能体的高效化和专业化。