3 步上手

【数据安全必读】

系统盘与数据盘均为本地 SSD,无冗余,单点故障可能导致数据永久丢失。

请务必将重要数据实时备份至「共享存储卷」或本地,共绩算力对本地盘损坏及数据丢失不承担任何责任。

立即开通共享存储卷,获得企业级冗余 + 跨区域同步,彻底告别数据丢失:

https://www.gongjiyun.com/docs/server/jojuw4rfdiepfxkchonctw0jnxe/yvawwrzvcivbypk8vihcgjrkn8c/

3 步快速上手流程:

Section titled “3 步快速上手流程:”利用我们预制的基础镜像快速创建云主机

1 用基础镜像创建云主机

Section titled “1 用基础镜像创建云主机”1.1 第一步:创建云主机

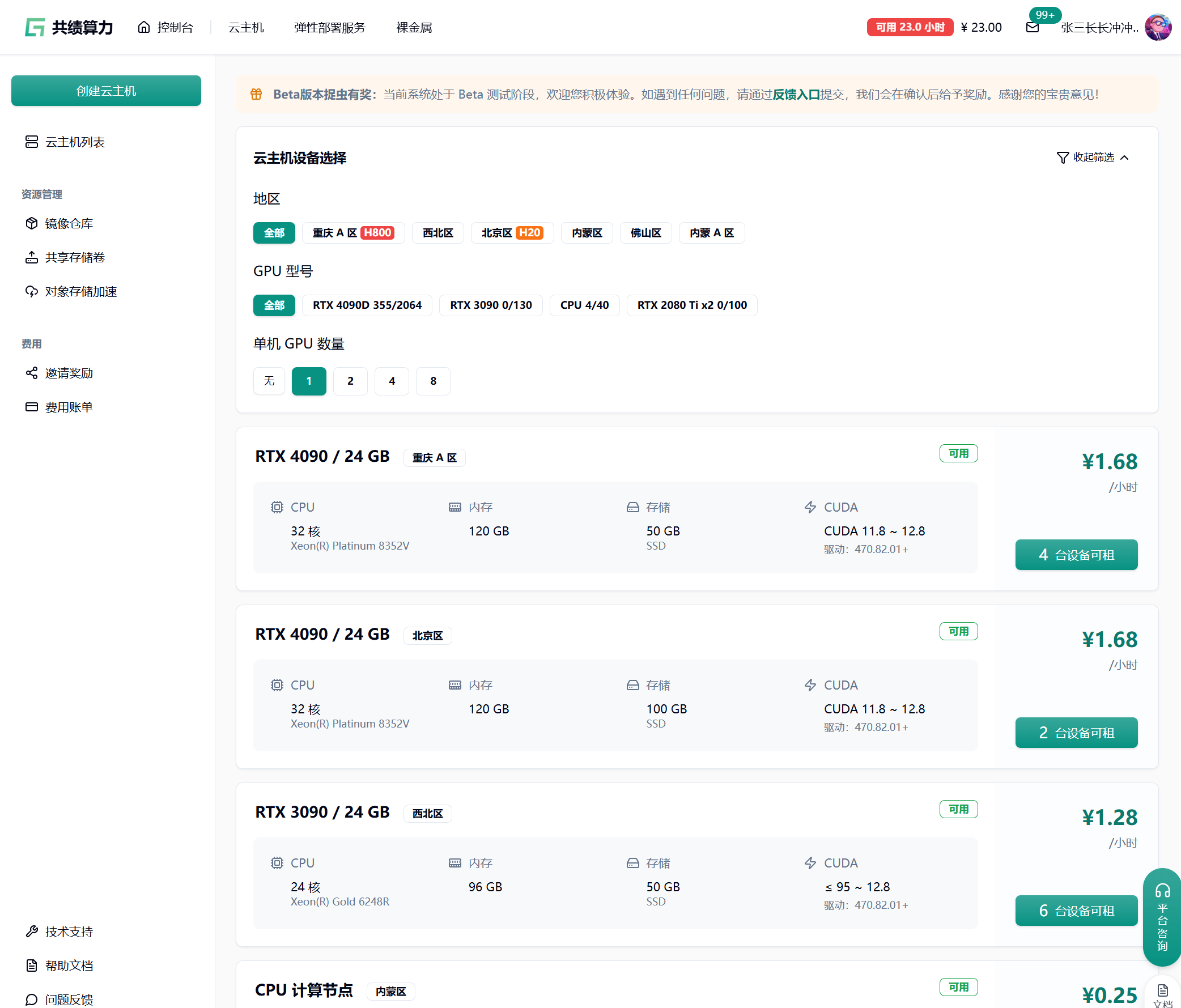

Section titled “1.1 第一步:创建云主机”点击顶部的【云主机】按钮,进入云主机界面:https://console-staging.suanli.cn/server

挑选合适的设备,本例中点击【4台设备可租】按钮

GPU 型号推荐配置:随便选

-

显存完全达标:

- 图片中所有型号单卡均提供 24GB 以上显存,远超服务部署启动的要求,无需担心显存不足。

-

性价比与灵活性:

- 1 卡配置:每小时仅需 1.68 元,按秒计费(0.000446 元/秒),适合短期测试或常规任务。

- 多卡选项备用:若未来需要多卡训练或高并发任务,可随时切换 2 卡/4 卡。

- 简化选择逻辑:

- 无特殊需求:如果只是运行文档镜像中的常规任务(如模型推理、数据处理),单卡性能完全足够。

- 兼容性无忧:镜像仓库默认适配主流 GPU 型号(如 4090),无需额外调试。

操作建议

- 随便选 直接选定合适的设备,快速完成部署。

- 进阶场景:仅当需要训练大模型(如 LLM、多模态)时,再考虑 2 卡/4 卡配置。

图片中的配置均为“无坑选项”,闭眼选 1 卡即可开箱即用,成本可控,资源立即可用。

1.2 第二步:配置资源

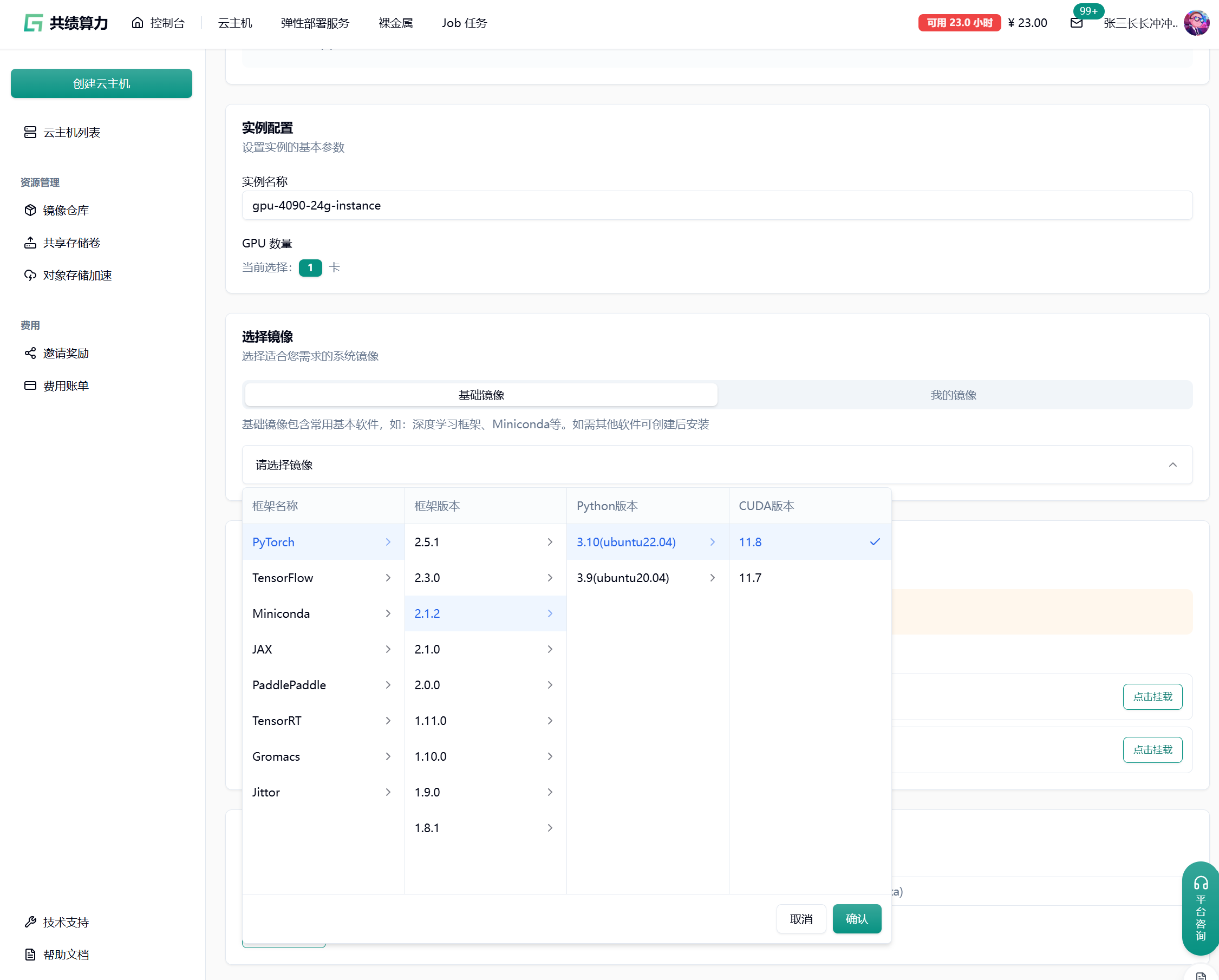

Section titled “1.2 第二步:配置资源”1.2.1 设置实例名称

Section titled “1.2.1 设置实例名称”为创建的开发机设置一个容易记住的名字,也可以采用系统自动生成的实例名称。

1.2.2 选择基础镜像

Section titled “1.2.2 选择基础镜像”按照需求选择我们预制好的镜像,同时可以通过文档链接快速了解容器化部署对应服务的步骤。

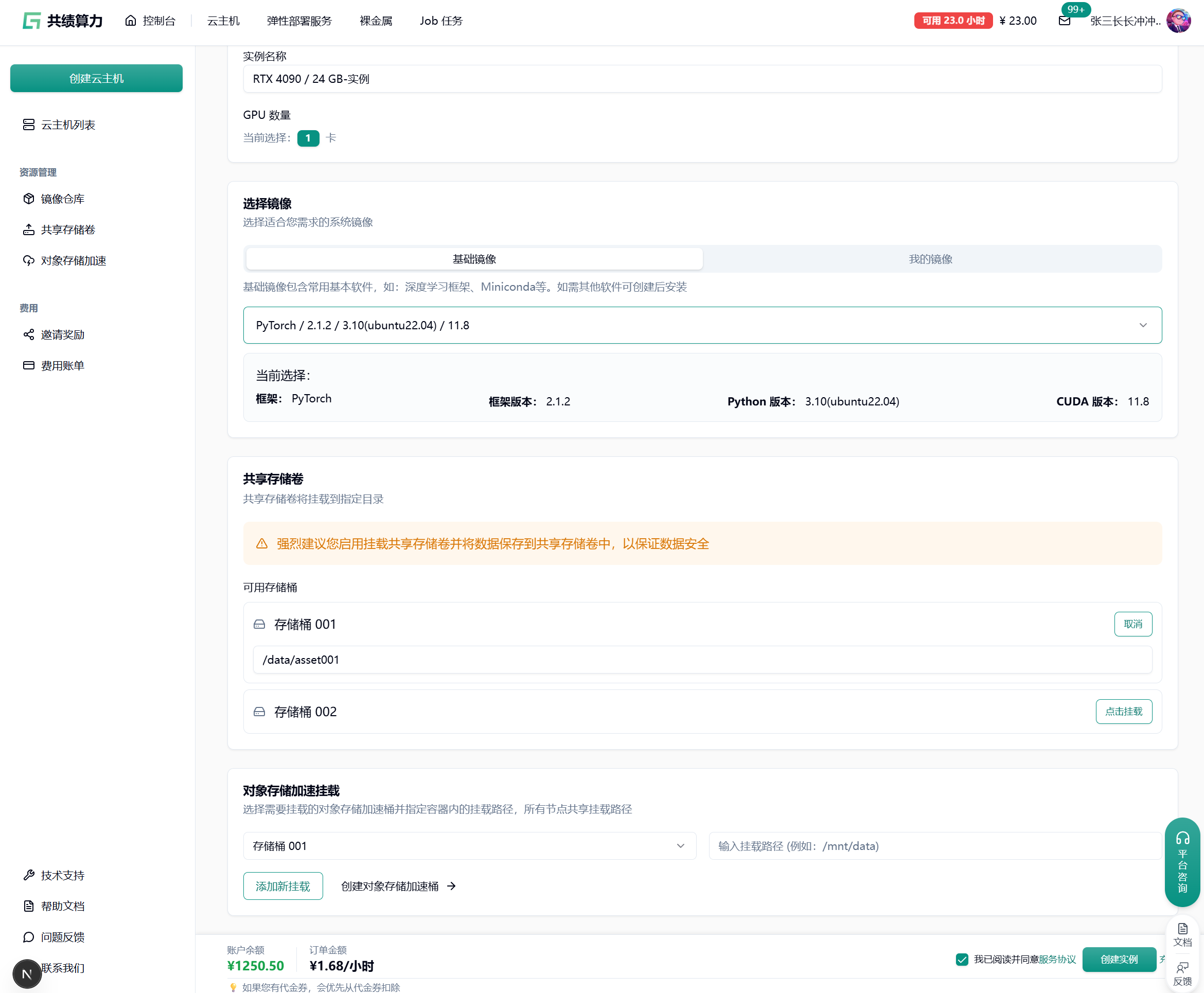

这里我们选择了 在 Ubuntu22.04 上运行的 PyTorch 的 2.1.2 版本,Python 为 3.10,CUDA 版本 11.9 的镜像作为示例。

- 平台默认提供了一批基础镜像供试用,可以根据实际需要选择合适的镜像

1.2.3 开通共享存储卷服务,挂载到本机目录

Section titled “1.2.3 开通共享存储卷服务,挂载到本机目录”

注意:

- 挂载存储的时候,不要直接挂载到/、/root、 /root/目录,否则会出现一些奇怪的问题。建议挂载在类似/root/data 、/root/code 之类的二级目录。

同意服务协议,点击【创建实例】按钮,完成云主机的创建过程。

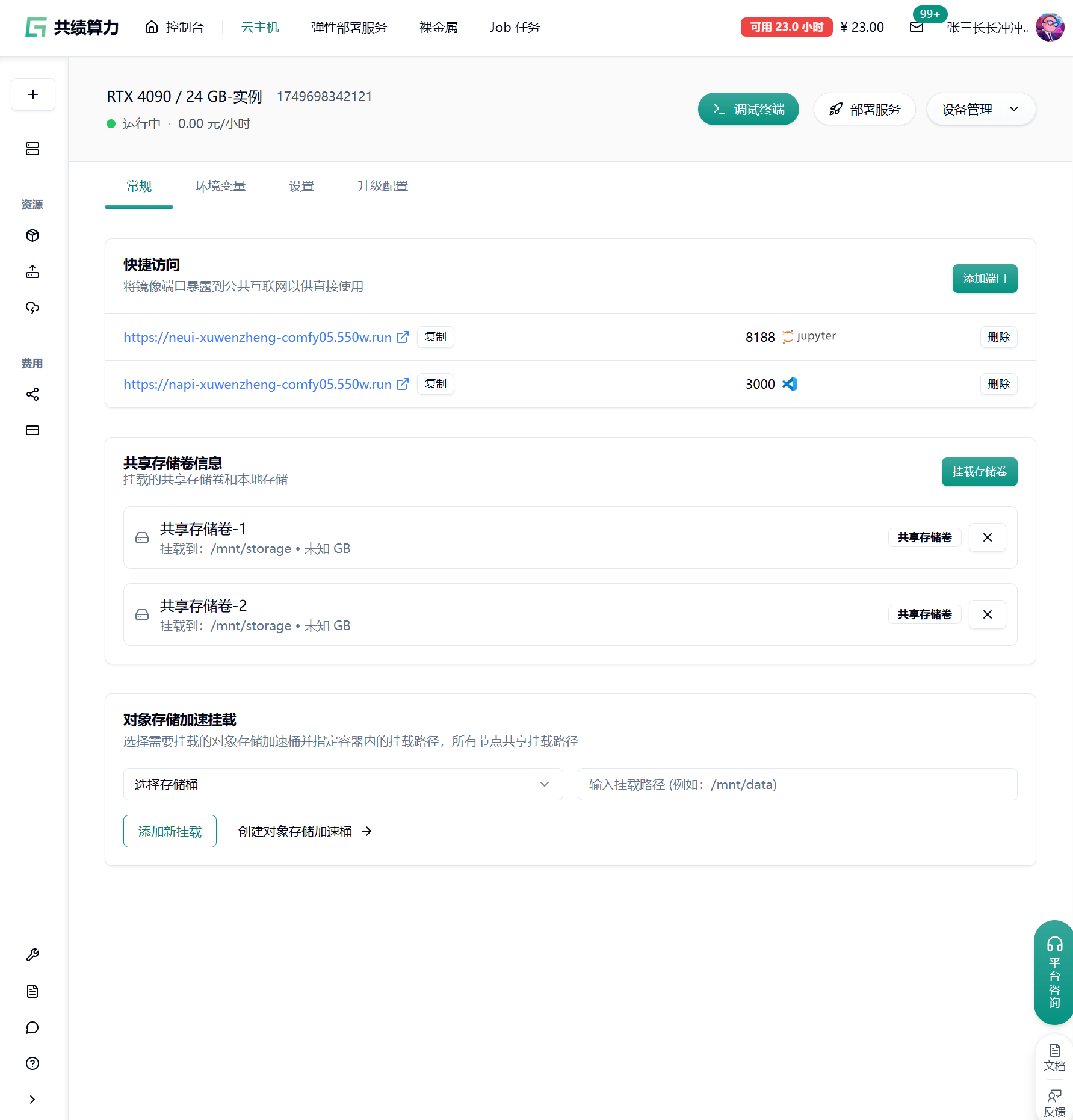

1.3 第三步:查看运行状态

Section titled “1.3 第三步:查看运行状态”

2 一些名词详细解释

Section titled “2 一些名词详细解释”2.1 GPU 型号(4090)

Section titled “2.1 GPU 型号(4090)”打个比方:

像不同规格的“工程机械车”:

- 1 卡/2 卡/4 卡/8 卡:代表单台机器搭载的 GPU 数量,类似一辆卡车能装 1 台或 8 台发动机,动力逐级增强。

- 显存 24GB:相当于车辆的“货仓容量”,决定了一次性能处理多少数据(如大型模型参数)。

- 内存 64GB & CPU 核心数 16:如同驾驶室的空间和司机数量,影响多任务并行处理效率。

- xxx 台设备可用:表示当前可用的“车辆库存”,库存越多,部署越快。

适用场景:

- 1 卡:常规任务(模型推理、数据处理)。

- 多卡:分布式训练、高并发计算(如大语言模型训练)。

2.2 服务配置(实例名称)

Section titled “2.2 服务配置(实例名称)”打个比方:

就像给项目文件贴标签,例如“2025-双十一促销数据分析”,方便后续查找和管理。

简而言之:

服务名称是用户为当前部署任务定义的唯一标识,建议采用「用途 + 日期」格式(如 image-classification-20250515),便于后续监控、管理和成本追踪。

2.3 基础镜像

Section titled “2.3 基础镜像”基础镜像是共绩算力平台为用户提供的一批“即开即用、极简配置、环境一致”的预置镜像。基础镜像兼容了本地开发习惯,支持多进程管理,非常方便后续平滑迁移到无状态服务部署。

镜像组成

- 基础系统

操作系统:Ubuntu 20.04 / 22.04(根据 CUDA 版本选择)

CUDA:11.8(20.04)/ 12.8(22.04),支持 AdaLovelace 架构(如 4090)

包管理:apt(默认更换为清华源,加速安装)

- Shell 与多进程管理

Bash:主交互 Shell

screen:多会话管理

supervisord:多进程管理器,统一管理各服务进程

- 远程与开发工具

SSH Server:支持通过环境变量配置用户名密码,便于远程开发

VSCode Server:预装插件(Python、Pylance、Jupyter、Python Debugger),自动配置解释器路径,自动激活 conda 环境

JupyterLab:预装插件(JupyterLab Debugger、LSP、TOC、LaTex、HTML、Matplotlib),默认启动 bash 终端,自动激活 conda 环境

miniconda:默认更换为清华源,自动加载 base 环境,管理 Python、pip、JupyterLab 等

- AI 框架支持

- PyTorch

支持版本:2.7.1、2.6.0、2.5.1、2.4.1、2.3.1、2.2.2、2.1.2、2.0.1、1.13.1、1.8.2

每个版本均兼容最高 Python、CUDA、Ubuntu 版本

- TensorFlow

支持版本(Python 版本需对应):2.19-py3.12、2.18-py3.12、2.15-py3.11、2.11-py3.10、2.7-py3.9、2.4-py3.8、2.1-py3.7、2.1-py2.7、1.15-py3.7、1.15-py2.7