快速上手弹性部署服务

请先在算力控制台完成注册并登录:https://console.suanli.cn

平台支持 两种方式 发布 Serverless GPU 任务:

- 使用平台预制镜像(推荐,新手最快)

- 使用用户自定义镜像

两种方式的整体流程一致,仅在「服务配置」步骤存在差异。

方式一:使用预制镜像发布任务(推荐)

Section titled “方式一:使用预制镜像发布任务(推荐)”Step 1:新增部署任务

Section titled “Step 1:新增部署任务”进入「新增部署任务」页面:https://console.suanli.cn/serverless/create

Step 2:填写任务信息

Section titled “Step 2:填写任务信息”2.1 选择计算资源

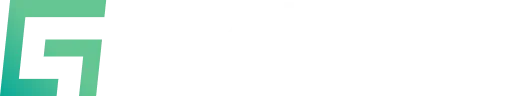

Section titled “2.1 选择计算资源”根据业务需求筛选 GPU 资源,包括:

所在区域,GPU 型号,显存大小,CPU 核心数,内存大小,节点数量

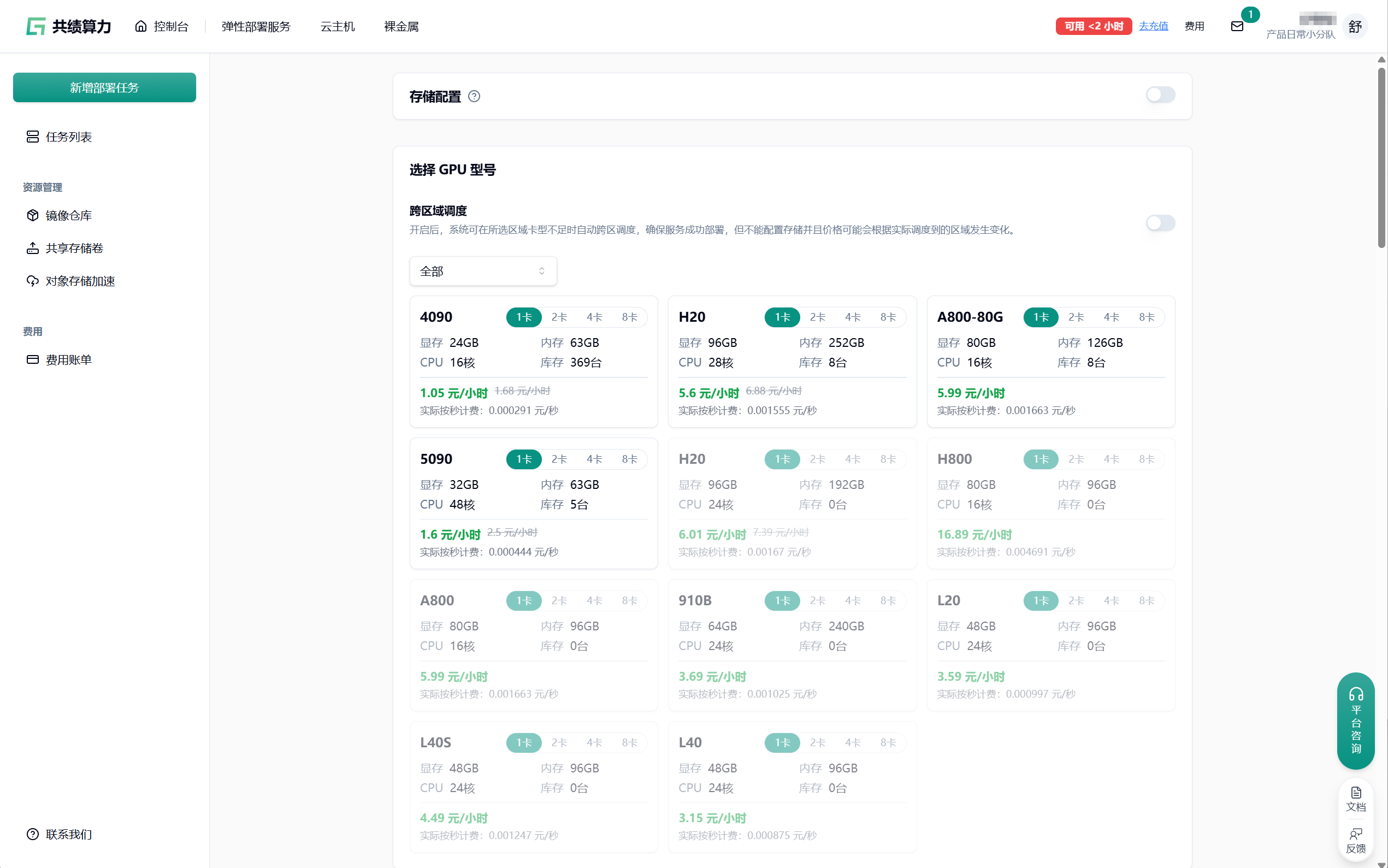

新手推荐配置(性价比高、快速部署)

- GPU 型号:4090

- 节点数量:1 个节点

- 区域:不限区域(自动匹配合适的算力节点)

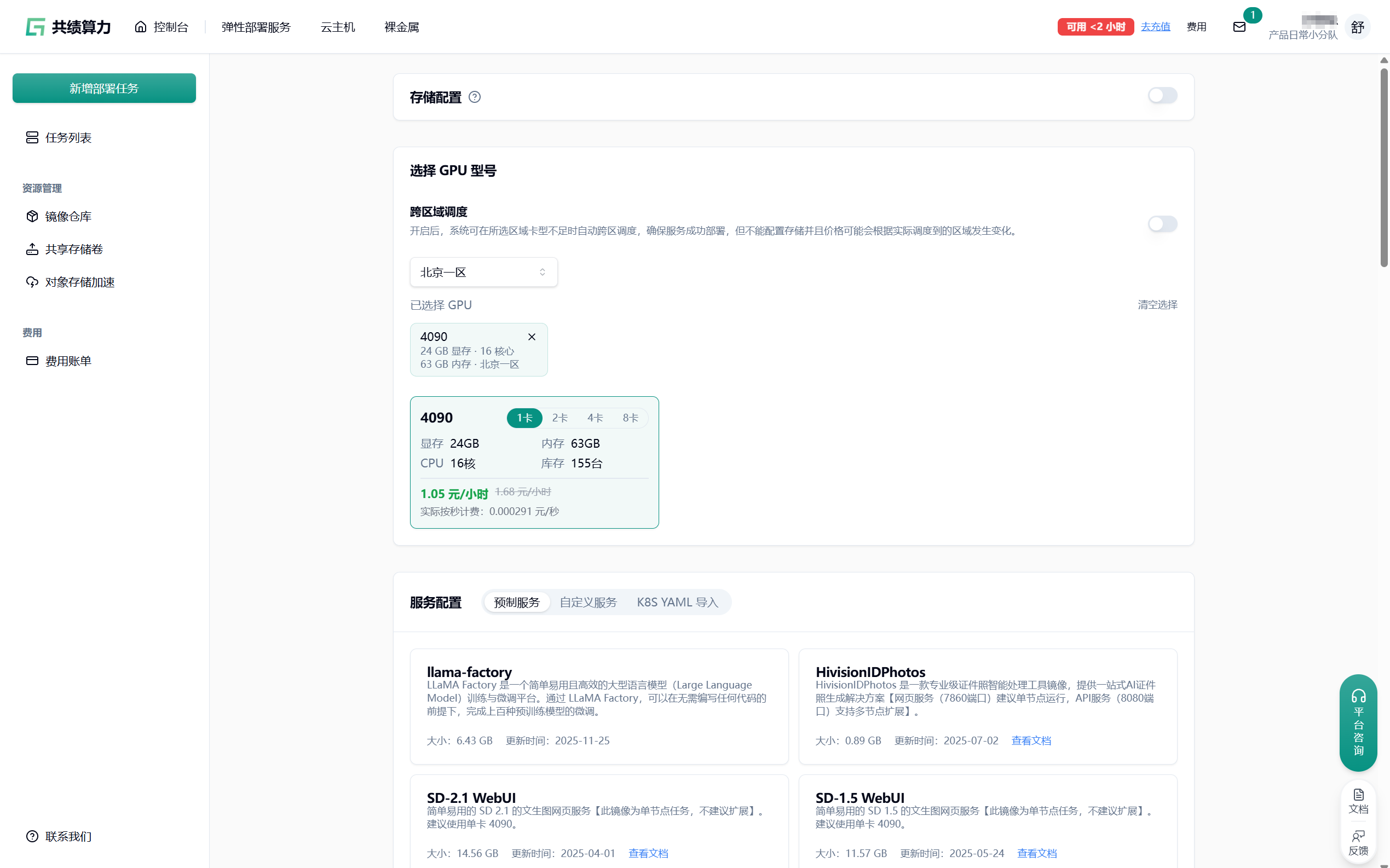

2.2 定义服务配置信息

Section titled “2.2 定义服务配置信息”在服务配置中,可以选择平台提供的 预制镜像,每个镜像均配有文档说明,方便快速了解部署和使用方式。

这里我们选择了 SD-3.5-Large comfyUI 作为示例

选择完成后,滚动到页面最下方点击 【部署服务】,提交任务。

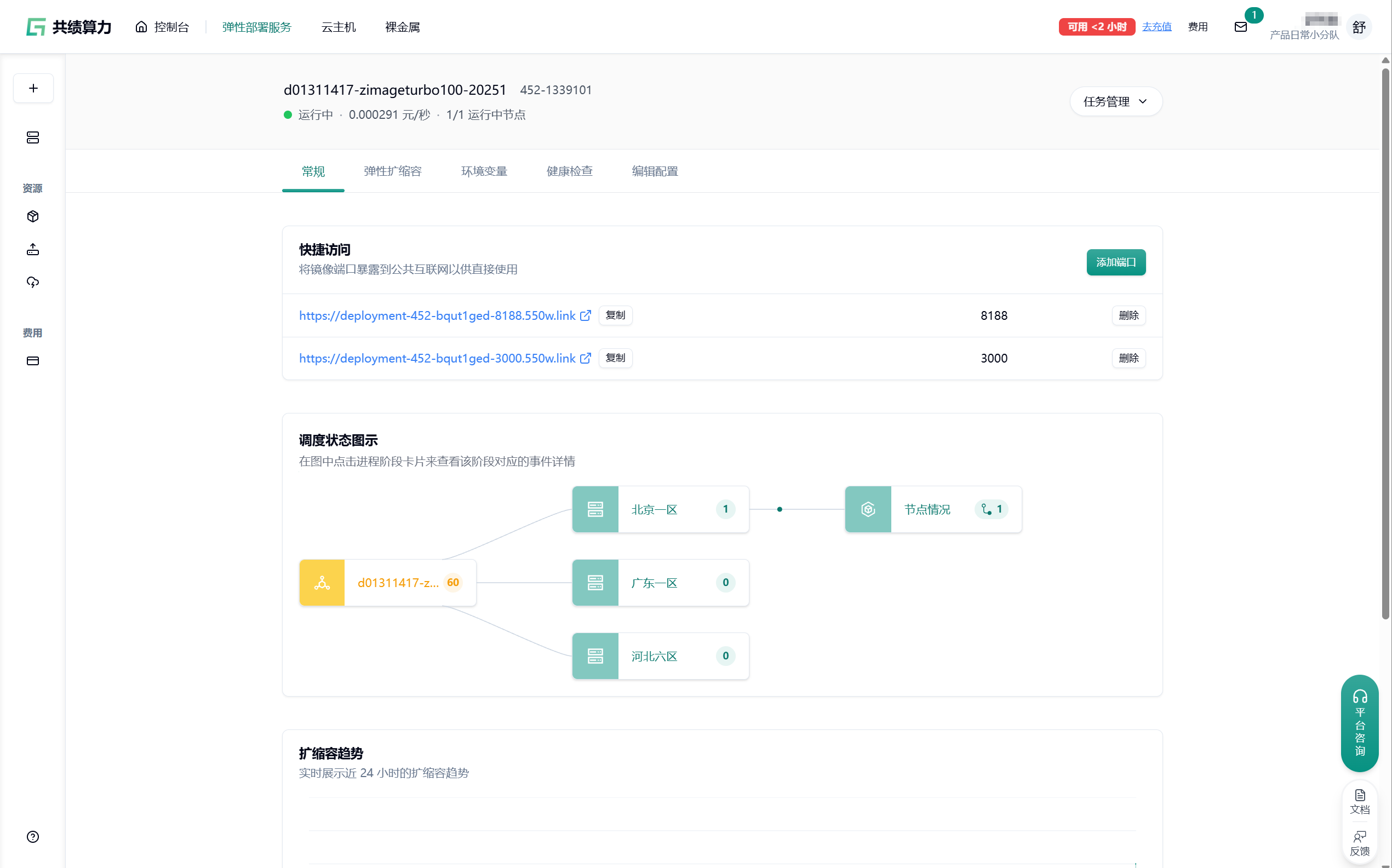

Step 3:查看运行状态

Section titled “Step 3:查看运行状态”任务发布后,系统将自动跳转至 任务详情页面,并开始分配计算节点。

当节点分配完成后,在「快捷访问」区域选择对应服务访问或 API 调用,具体使用方法可以参考对应镜像文档。

方式二:使用用户自定义镜像发布任务

Section titled “方式二:使用用户自定义镜像发布任务”使用自定义镜像发布任务的流程与「方式一」完全一致,唯一差异在于服务配置步骤。

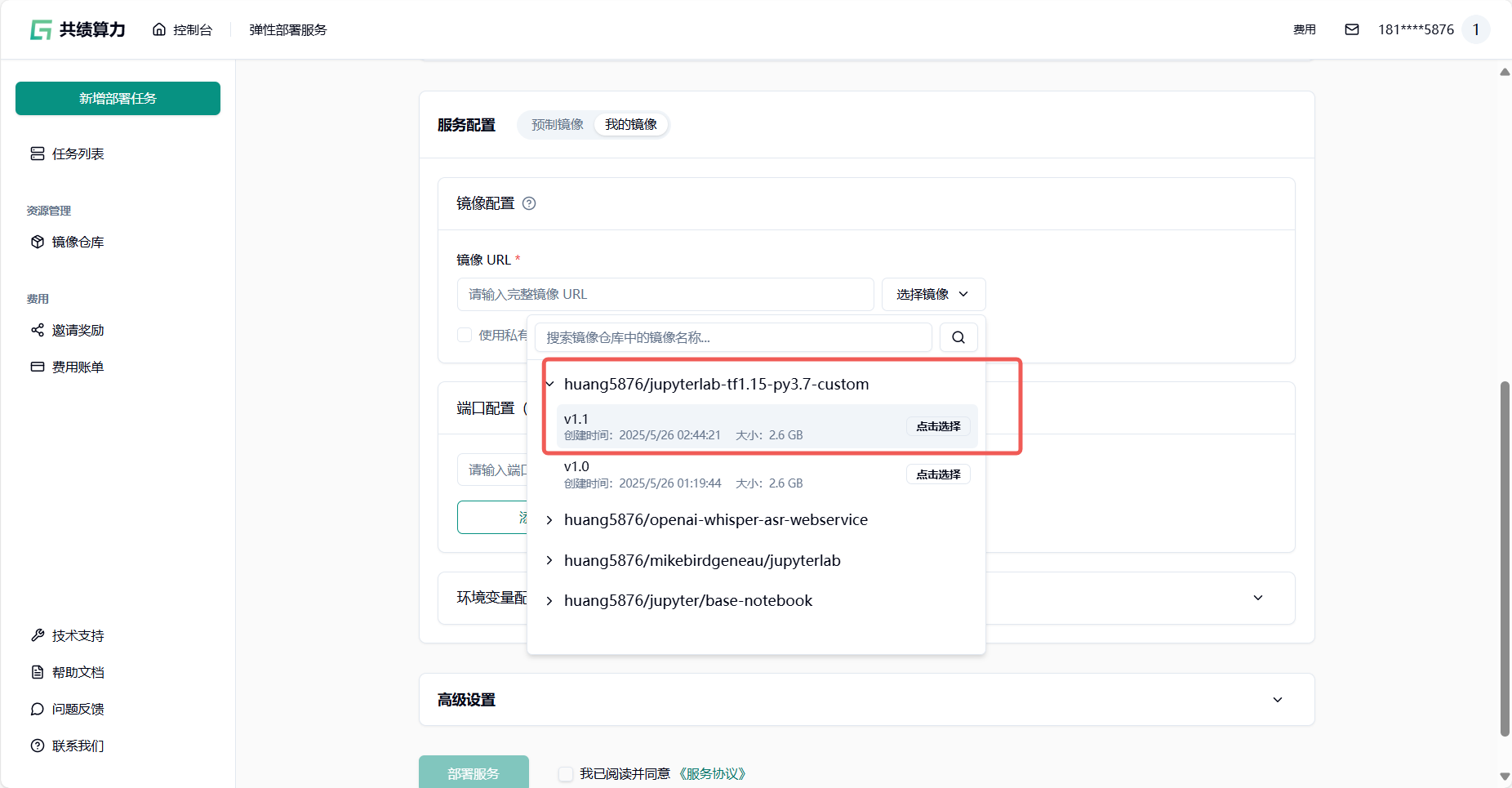

在「服务配置」中选择 我的镜像,并填写镜像信息。

平台支持两种镜像来源:

第一种:第三方公共镜像仓库

支持 Docker Hub、阿里云镜像仓库等公共仓库,这里以 SD-3.5-Large comfyUI 为例。

镜像地址:crpi-r5vaz7ed9e06uteg.cn-shanghai.personal.cr.aliyuncs.com/lightcloud/sd-webui:1.8

端口号:7860

第二种:平台私有镜像仓库

如需使用平台私有镜像仓库,请先完成镜像推送(可参考 镜像仓库 ),随后在页面中刷新并选择对应镜像。

示例私有镜像地址库:harbor.suanleme.cn/huang5876/jupyter_tf2_18:v1.0

版本信息:python3.12+tensorflow-gpu2.18.1

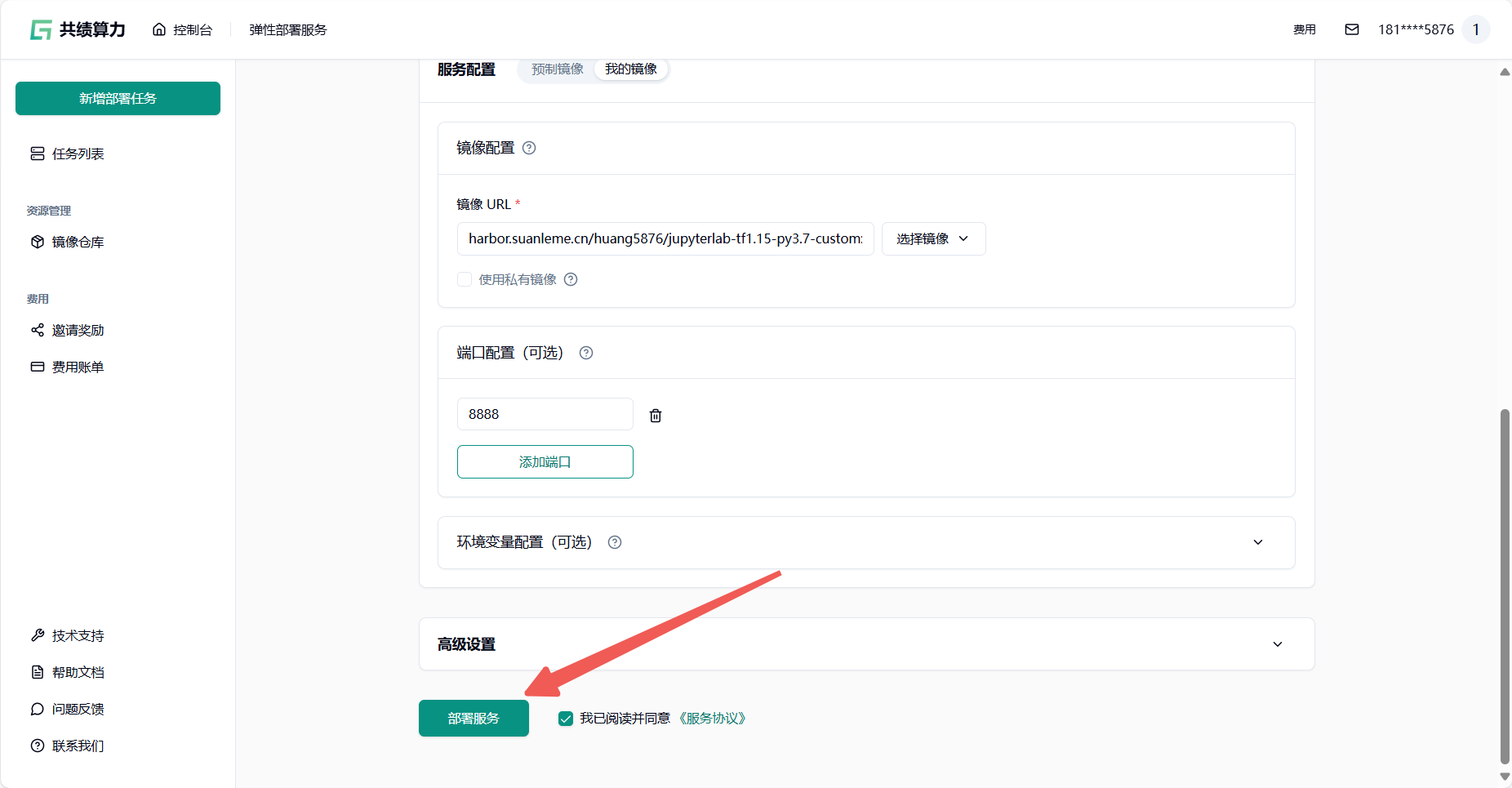

完成镜像 URL 填写后进行端口配置(这里以 JupyterLab 为例 端口号填写8888)

注意:Jupyter 类服务建议仅使用 1 个节点,多节点可能导致访问异常。

配置完成后,点击 【部署服务】 发布任务。

指创建一个新的 Serverless 服务实例,用于分配计算资源并运行指定镜像。

包含内容:

- 资源管理:GPU、CPU、内存等资源分配

- 镜像管理:指定运行环境

- 费用记录:按使用时长生成账单

GPU 型号

Section titled “GPU 型号”GPU 型号代表单个节点的计算能力规格:

- 1 卡 / 2 卡 / 4 卡 / 8 卡:单节点 GPU 数量

- 显存大小:决定可运行模型规模

- CPU / 内存:影响多任务并发能力

- 库存数量:当前可用资源规模

适用场景:

- 1 卡:模型推理、数据处理

- 多卡:分布式训练、高并发计算

显存要求(≥16GB)

Section titled “显存要求(≥16GB)”显存用于存储模型参数和中间计算数据。

- 16GB:中等规模模型的最低需求

- 24GB(如 4090):可稳定运行主流 AI 推理服务

节点代表相同配置的计算实例数量。

- 1 节点:单任务或低并发场景

- 多节点:并行计算或横向扩展

建议先使用 1 个节点 验证任务运行情况,再根据需要扩展。

服务名称是当前部署任务的唯一标识。

建议命名规范:用途-日期

示例:image-generation-20250515

便于后续管理、监控和成本统计。