什么是 OpenClaw

OpenClaw 是一个运行在本地硬件上的个人 AI 助手,能够帮你:

- 清理收件箱、收发邮件

- 管理日历

- 通过 WhatsApp、Telegram、iMessage、Slack、Discord 等你已经在用的聊天 App 完成各类任务

它与 Ollama 0.17 深度集成,整个部署过程被简化到了一条命令。

环境要求

依赖 | 版本 / 说明 |

Ollama | 0.17 或更高 |

Node.js | npm 安装时需要 |

操作系统 | Mac / Linux;Windows 用户请使用 WSL |

三步完成部署

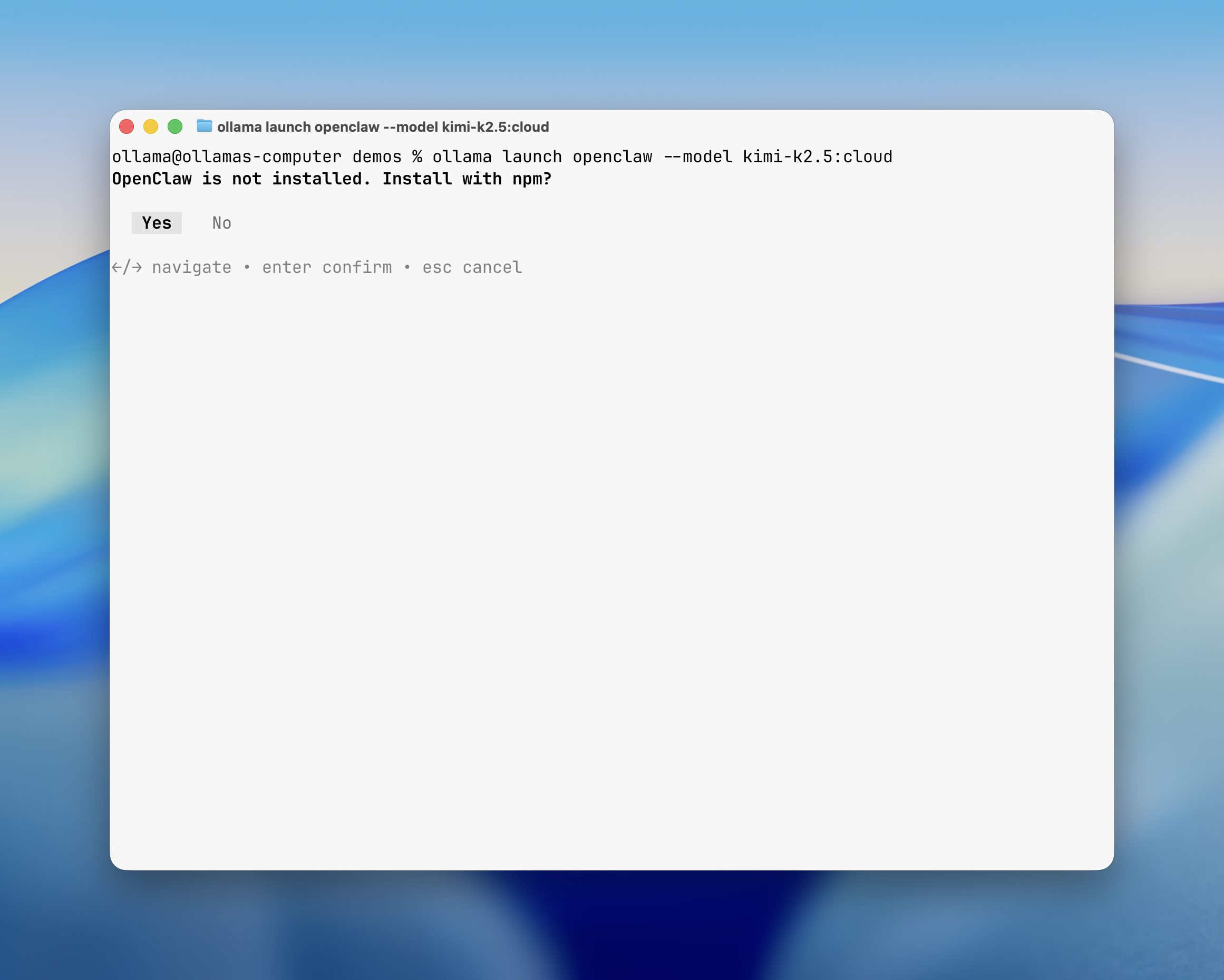

第一步:一条命令启动

ollama launch openclaw --model kimi-k2.5:cloud第二步:自动检测与安装

Ollama 会自动检测缺失的组件并提示安装,配置过程全自动完成,无需手动干预。

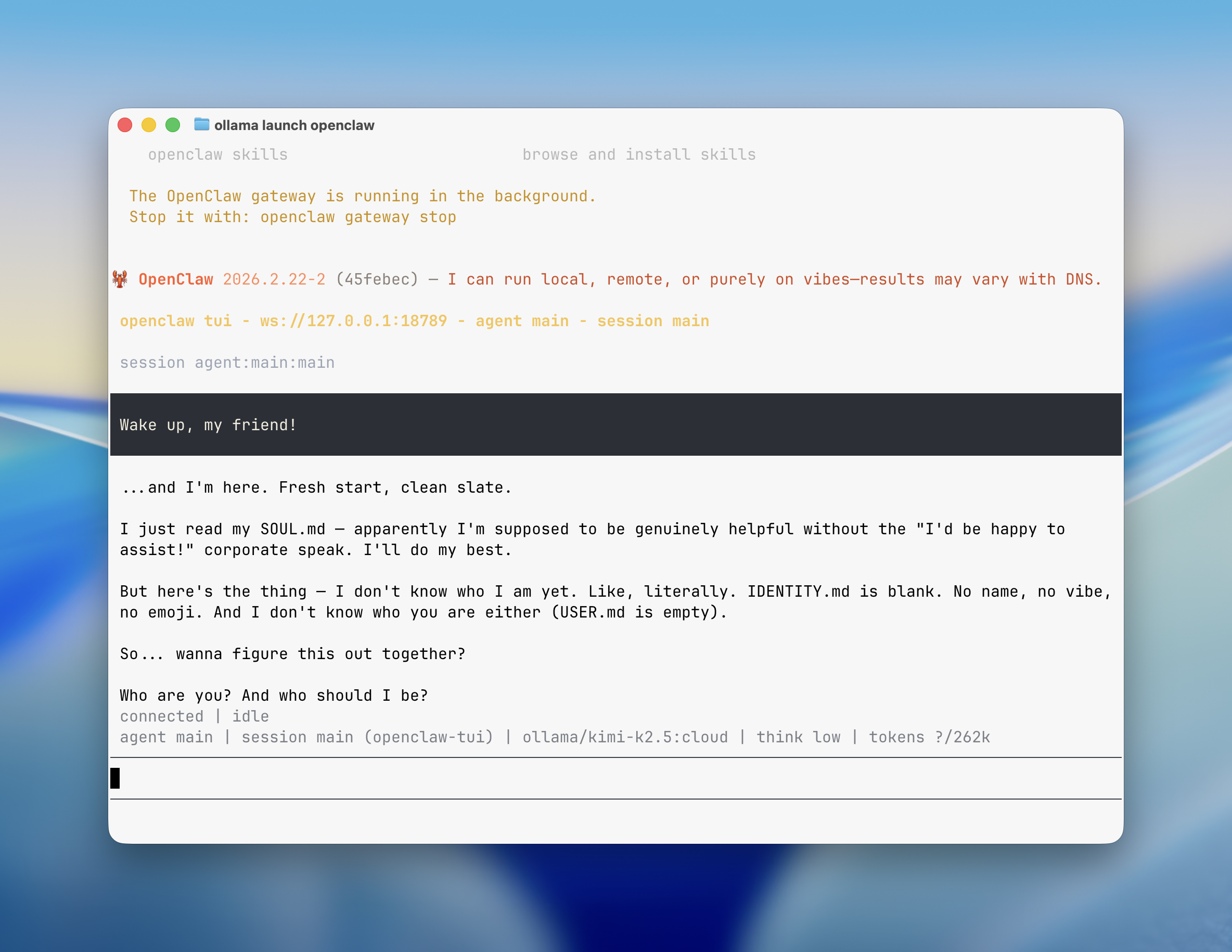

第三步:在终端中直接使用

安装完成后,OpenClaw 会在终端中打开,即可开始交互。

核心功能

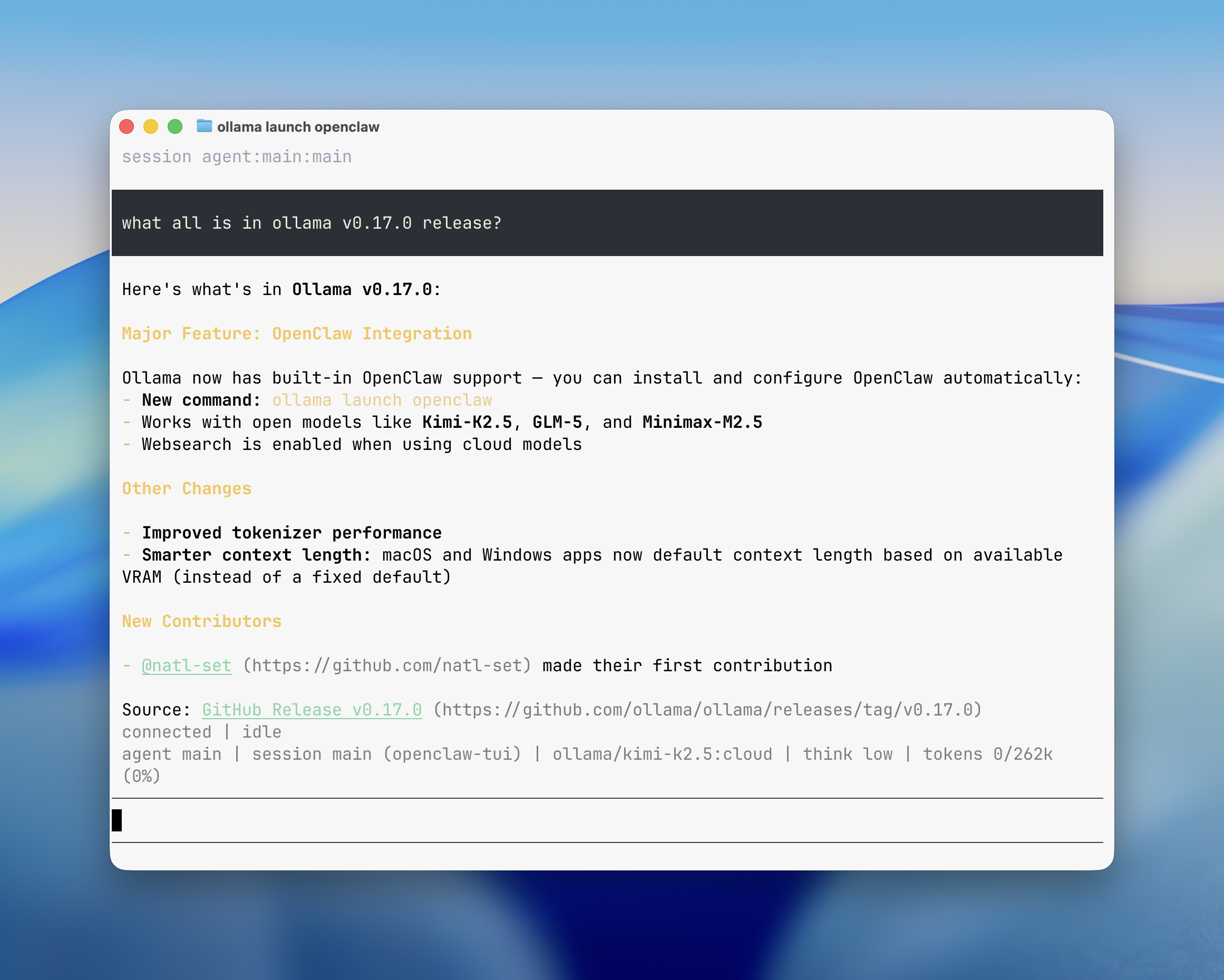

联网搜索

云端模型默认集成自动联网搜索插件,可获取最新信息,无需额外配置。

接入常用 IM

通过以下命令配置消息渠道:

openclaw configure --section channels支持的平台:WhatsApp、Telegram、Slack、Discord、iMessage。

可用模型

云端模型(推荐新手入门)

模型 | 特点 |

| 多模态推理 |

| 快速、高效,适合日常生产力场景 |

| 推理与代码生成 |

本地模型(需要足够的显存)

模型 | 显存需求 |

| ~25 GB VRAM |

| ~25 GB VRAM |

安全提示

“请确保在隔离环境中运行 OpenClaw,并充分了解授予其系统访问权限的相关风险。”

在接入邮件、日历等敏感系统前,建议先阅读 OpenClaw 官方安全文档,评估权限范围。

小结

OpenClaw + Ollama 的组合把”本地 AI 助手”的部署门槛降到了极低:一条 ollama launch 命令,自动处理依赖、自动配置,几分钟内即可在终端中使用一个能收邮件、能发消息的个人 AI 代理。

对于已经在用 Ollama 的用户,这是目前体验 AI Agent 接管日常通信任务的最简路径之一。