最近我们在共绩算力上反复测试一件事:

把 Claude 风格的推理蒸馏模型,真正接进龙虾(OpenClaw)这种带思考链、工具调用、工作流执行的 Agent 场景里,看它到底能不能干活。

这次主要看两条线:

- 9B 版本:便宜、快,适不适合先接起来

- 27B 版本:更强,能不能更像 Claude 一样在 OpenClaw 里承担“主脑”角色

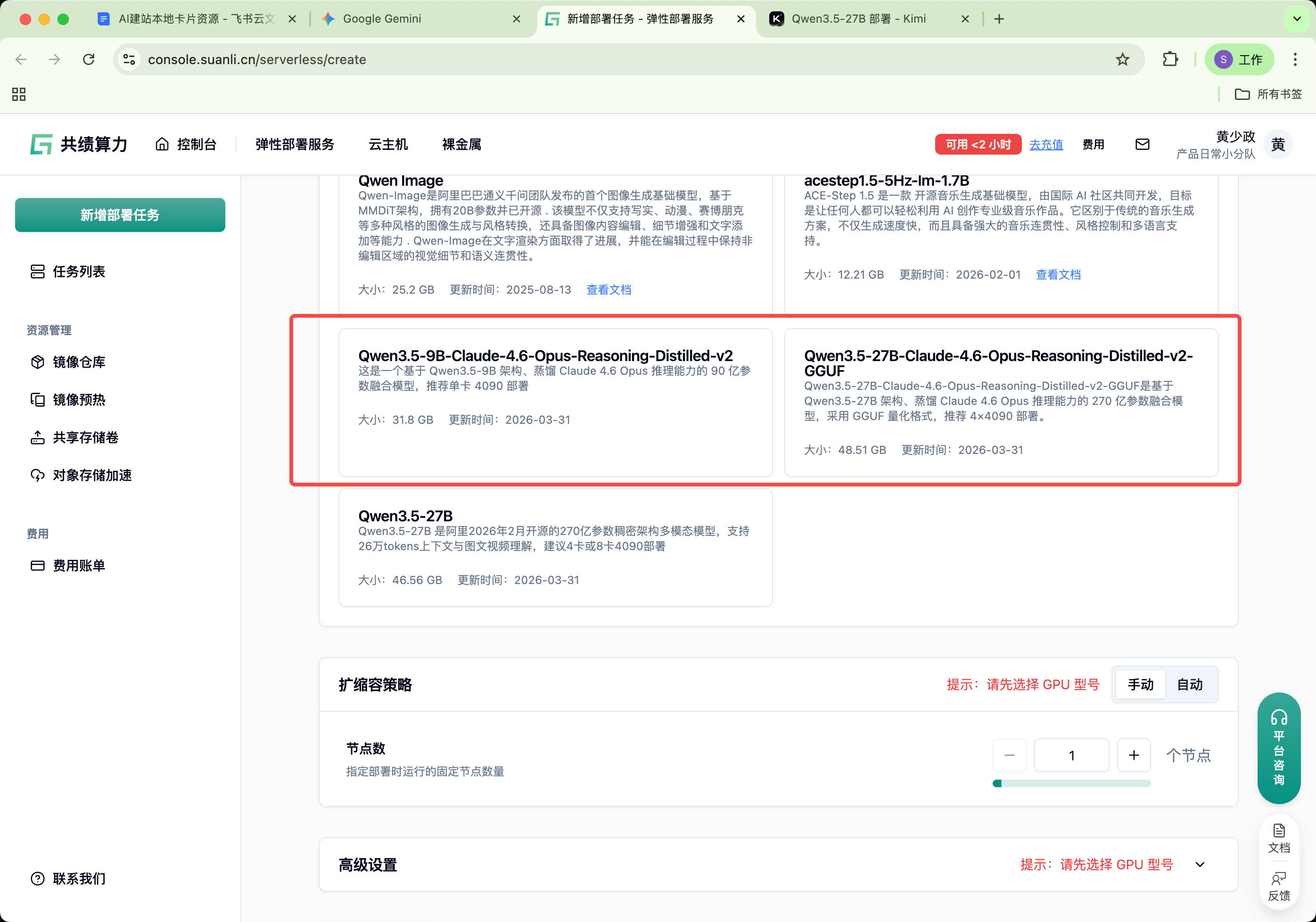

涉及的模型分别是:

- 9B:

Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled - 27B:

Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled-v2

模型公开地址:

- 9B Hugging Face:https://huggingface.co/Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled

- 9B 魔搭(v2):https://www.modelscope.cn/models/Jackrong/Qwen3.5-9B-Claude-4.6-Opus-Reasoning-Distilled-v2

- 27B Hugging Face:https://huggingface.co/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled-v2

- 27B 魔搭:https://modelscope.cn/models/Jackrong/Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled

先说结论:如果你是在共绩算力上用这类模型,重点已经不是自己从零拼环境了。卡是充足的,镜像也已经打成预制镜像,真正决定体验的,是你准备用它做什么。 是先拿来做轻量 API,还是直接接 OpenClaw 跑工具调用和长链路工作流,这两种用法的关注点完全不同。

一、什么模型

一句话说,它不是把 Claude“搬过来”,而是让 Qwen 学会一种更像 Claude 的思考方式。

所以它最有价值的地方,不是聊天更花哨,而是更适合做这些事:

- 先拆问题,再执行

- 做结构化推理,而不是直接拍脑袋回答

- 接工具调用和工作流时,更像一个“会规划的模型”

- 在代码、分析、任务拆解场景里,更接近大家熟悉的 Claude 使用感

你可以把它理解成:

不是最适合陪聊的一类模型,但很适合放进内部工作流里干活。

这也是为什么,我更愿意把它看成一种工作模型,而不是普通聊天模型。

二、为什么适合龙虾(OpenClaw)

龙虾这种 Agent 框架,最看重的不是一句话答得漂不漂亮,而是模型能不能:

- 先理解目标

- 再拆步骤

- 再判断要不要调工具

- 最后把结果整理成可执行输出

这恰好就是这类 reasoning 蒸馏模型的强项。

如果把它放进 OpenClaw,最有价值的不是“它支持 OpenAI 兼容接口”,而是它在工作流里更像一个会思考的主模型:

- 工具调用前,它更容易先判断该不该调用

- 工具返回后,它更容易继续接着推理

- 面对多步骤任务,它更像在做规划,而不是一次性瞎答

- 做代码、分析、任务拆解时,更容易给出成体系的输出

这也是为什么我会说,它不是“聊天平替”,而更像“工作流平替”。

真接进 OpenClaw 时,有一个现实问题要处理:

有些时候,模型会把更多内容放在 message.reasoning 里,而不是 message.content。如果你的解析逻辑只认 content,系统就会误以为“它没说话”。

所以在龙虾里,模型适配层最好这样处理:

- 优先读

message.content - 若为空,再兼容

message.reasoning - 对

finish_reason: length做兜底处理

只要这层做好,它放进 OpenClaw 里是能跑起来的,而且很有机会比普通模型更像一个“会干活的主脑”。

为了不只停留在概念上,我们也直接对 qwopus_27b 做了一次真实调用,给它的任务是:

在 OpenClaw 里做一个“文章抓取、摘要、提炼行动项、发飞书”的工作流,请输出 4 步方案,并补一句最关键的工程提醒。

这次调用里,模型最有意思的地方不是一句漂亮结论,而是它在 reasoning 里自动表现出了很强的任务拆解能力。它会先自己做一轮内部规划,大致是这样的顺序:

1. 分析需求:明确目标、功能、约束、角色2. 拆解步骤:抓取 -> 摘要 -> 提炼行动项 -> 发送飞书3. 草拟方案:先给出一版工作流结构4. 优化与精简:为了满足“4 步方案”的要求再次修正输出这其实很像人在做 Agent 设计时的思路:不是直接往外喷答案,而是先把任务边界、工具位置、输出格式想清楚。

我们还拿它测了一次更偏工程判断的题:让它分析“用户上传 PDF -> 抽取文本 -> 摘要 -> 入库 -> 通知企业微信群”这个流程里最容易被忽略的风险。它给出的前几项风险是:

- 任务幂等性与状态机缺失

- 第三方服务(LLM / OCR)的不可靠性

- 数据隐私与合规

- 长耗时任务的用户反馈

- 异常数据带来的重试风暴

这类回答的价值在于:它不是泛泛说“注意稳定性”,而是能把问题拆成工程团队真的能接着落地的风险清单。这也是为什么,27B 版本一旦接进 OpenClaw,更像一个可用的主模型,而不只是一个会聊天的模型。

三、9B / 27B 怎么选

这部分不讲复杂参数,只讲最直接的使用判断。

先说 9B

如果你现在最关心的是:

- 先把 API 接起来

- 先让 SDK 跑通

- 先做一版低成本试跑

- 先给 OpenClaw 接一个轻量模型

那 9B 更适合当入口版本。

它的优势很直接:

- 更便宜

- 更轻

- 更容易接入

- 冒烟和联调更省心

它当然也会有 reasoning 字段的问题,但整体上没 27B 那么挑解析逻辑。

所以 9B 更像什么?

一个便宜、稳定、适合先试起来的版本。

再说 27B

如果你真正想要的是:

- 在 OpenClaw 里承担主模型角色

- 做复杂任务拆解

- 做更长链路的工具调用和工作流执行

- 追求更接近 Claude 的工作方式

那 27B 四卡版更值得上。

它的问题不是不能用,而是更像一个真正会长思考的模型,所以也更挑接法。最典型的情况就是:

- 接口能回

200 - 流式和非流式都能工作

- 但有些请求里,

content可能为空 - 真正内容更多落在

reasoning

这对聊天客户端只是“有点怪”,但对 Agent 框架就很关键。

所以 27B 更适合:

- 你能控制模型适配层

- 你愿意同时消费

content和reasoning - 你本来就是奔着 OpenClaw 主模型去的

它不是最省事的版本,但更可能是体验更像 Claude 的版本。

从我们这次真实调用看,27B 最能体现价值的地方不是“回答更长”,而是它会自己把任务先拆开、再修正、再落到执行层。这种能力一旦放进 OpenClaw,就很适合承担:

- 工作流编排里的决策节点

- 工具调用前的判断节点

- 复杂任务的总控节点

- 编码 / 分析类 Agent 的主模型角色

如果只给一个最实用的选择建议:

- 先接起来、低成本试跑:选

qwopus_9b - 希望在龙虾里承担主模型角色:选

qwopus_27b

四、为什么它算 Claude 平替

“Claude 平替”这四个字,最容易被说虚。

如果你把它理解成“全面替代 Claude”,那当然不准确。 但如果你的语境是:

- 内部工作流

- OpenClaw / Copilot

- 编码任务

- 分析和拆解任务

- 想要一个更低成本、随取随用的主模型

那它确实很像一种Claude 风格平替。

理由主要有三点。

1. 成本更可控

Claude 官方 API 的体验很成熟,但一旦进入下面这些场景,成本就会越来越敏感:

- 高频 coding assistant

- 多轮 Agent 调度

- 长上下文分析

- 大量内部自动化任务

如果模型直接跑在共绩算力实例上,成本结构就从“按调用量持续付费”,变成“算力资源可预估、任务可以批量消化”。

这对团队内部使用很重要。

2. 随取随用

它真正的现实意义不是榜单分数,而是:

- 不用排 API 配额

- 不用担心外部服务波动

- 不用每次都把内部上下文发到外部闭源接口

在 OpenClaw、内部 Copilot、研发助手、代码审查、测试用例生成这些场景里,能随时起一个可用的推理模型,本身就是生产力。

3. 工作方式足够像 Claude

之所以很多人会把它拿来和 Claude 对比,不是因为它等于 Claude,而是因为它在一些关键工作方式上已经足够接近:

- 遇到复杂任务会先思考

- 更适合结构化推理而不是一句话瞎答

- 放进 Agent 工作流里,更像“会拆任务的模型”

- 配合工具调用和工作流编排时,行为更稳定

所以更准确的说法应该是:

它不是通用聊天意义上的 Claude 替代品,而是内部工作流、编码任务、Agent 执行链路里的 Claude 风格替代品。

五、如果今天就要开始用,我的建议是什么

如果你现在就在共绩算力上准备试:

- 先用预制镜像把模型起起来

- 先接一版 OpenClaw 跑真实工作流

- 确认体验好,再考虑扩大并发和对外服务

别一上来就纠结最复杂的参数。 在这类模型上,先看它在你的工作流里顺不顺手,比先看 benchmark 更有意义。

如果非要一句话总结怎么选:

- 先试跑:

qwopus_9b - 想让它在龙虾里像 Claude 一样承担主脑角色:

qwopus_27b

六、快速调用示例

9B:

curl "https://deployment-452-uqtednya-8000.550w.link/v1/chat/completions" -H "Content-Type: application/json" -d '{ "model":"qwopus_9b", "messages":[{"role":"user","content":"你好"}], "max_tokens":256 }'27B:

curl "https://deployment-452-kqiifoh5-8000.550w.link/v1/chat/completions" -H "Content-Type: application/json" -d '{ "model":"qwopus_27b", "messages":[{"role":"user","content":"你好"}], "max_tokens":512 }'如果你是自己写 OpenClaw 适配层,最实用的处理方式还是:

- 优先读

choices[0].message.content - 若为空,再读

choices[0].message.reasoning - 若

finish_reason == "length",补一个“可能被截断”的兜底提示

七、最后一句话总结

这次在共绩算力上的实践给我的结论很明确:

Qwopus 这类 Claude 推理蒸馏模型,不只是“能不能跑”的问题,而是“能不能放进你的工作流里真正干活”。

如果你的目标是找一个便宜聊天模型,它未必是最优解; 但如果你的目标是给 OpenClaw、Copilot、内部智能体、代码与分析流程找一个更便宜、随取随用、工作方式更像 Claude 的主模型,那它很值得试。